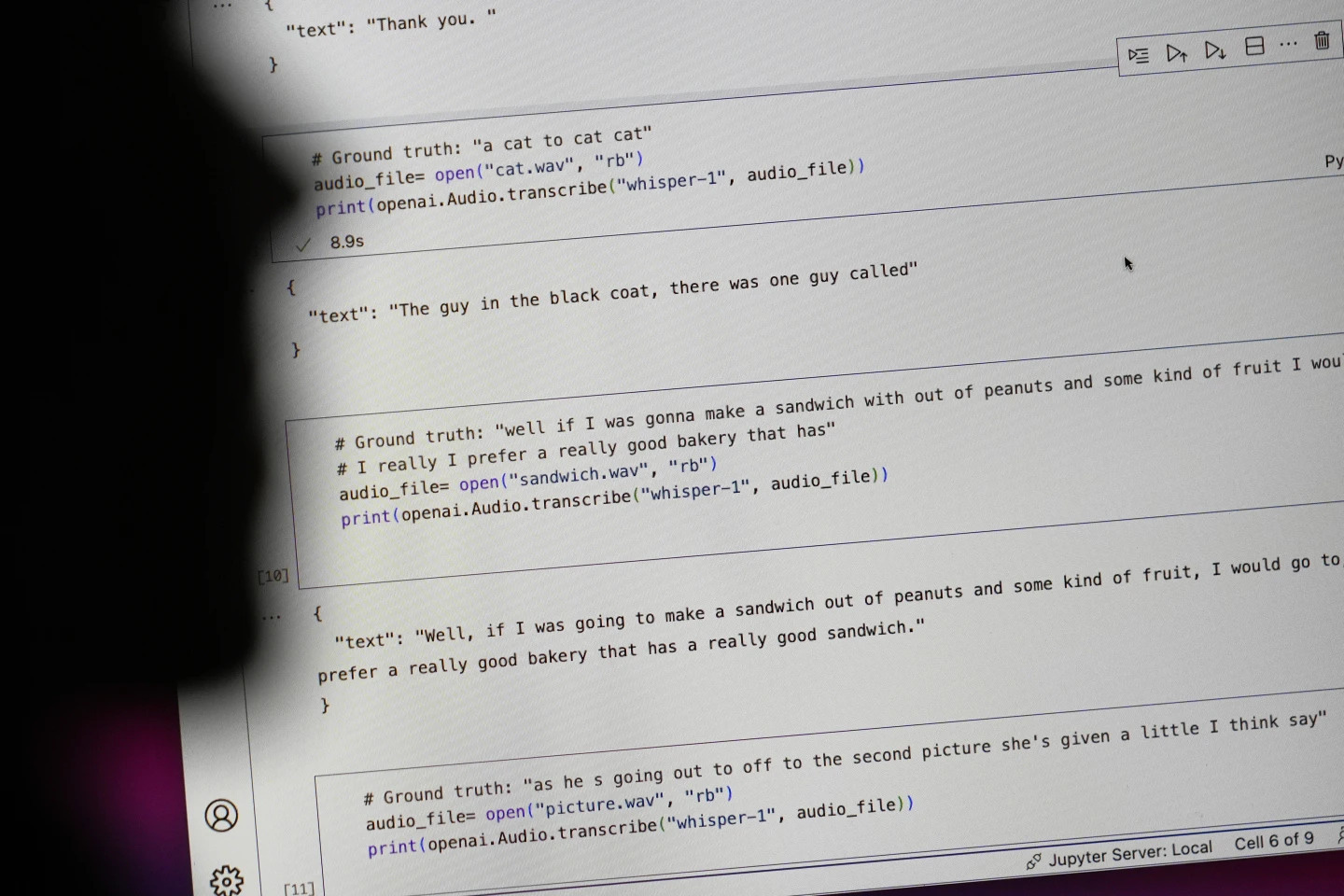

Le géant technologique OpenAI a présenté son outil de conversion de la parole en texte Whisper comme une IA dotée d'une « précision et d'une robustesse comparables à celles des humains ». Mais Whisper présente un défaut majeur : il génère des textes et des phrases totalement erronés.

Certains textes générés par l'IA — appelés « hallucinations » — peuvent inclure des commentaires racistes, un langage violent et même des traitements médicaux imaginaires. — Photo : AP

Certains textes générés par l’IA sont irréels, qualifiés d’« hallucinatoires », selon AP, et incluent des commentaires racistes, un langage violent et même des traitements médicaux imaginaires.

Taux élevé d'« illusion » dans les textes générés par l'IA

Les experts sont particulièrement préoccupés car Whisper est largement utilisé dans de nombreux secteurs à travers le monde pour traduire et transcrire des interviews, générer du texte dans des technologies grand public populaires et créer des sous-titres pour des vidéos.

Plus inquiétant encore, de nombreux centres médicaux utilisent Whisper pour transférer les consultations entre médecins et patients, bien qu’OpenAI ait averti que l’outil ne devrait pas être utilisé dans les zones « à haut risque ».

L'ampleur réelle du problème est difficile à déterminer, mais les chercheurs et les ingénieurs affirment qu'ils rencontrent régulièrement des « hallucinations » de Whisper dans leur travail.

Un chercheur de l'Université du Michigan a déclaré avoir trouvé des « hallucinations » dans huit transcriptions audio sur dix qu'il a examinées. Un ingénieur informatique a également trouvé des « hallucinations » dans environ la moitié des transcriptions de plus de 100 heures d'audio qu'il a analysées. Un autre développeur a déclaré avoir trouvé des « hallucinations » dans la quasi-totalité des 26 000 enregistrements qu'il a créés avec Whisper.

Le problème persiste même avec des échantillons audio courts et clairement enregistrés. Une étude récente menée par des informaticiens a identifié 187 « illusions » dans plus de 13 000 extraits audio clairs examinés. Cette tendance entraînerait des dizaines de milliers de fausses transcriptions dans des millions d'enregistrements, ont indiqué les chercheurs.

De telles erreurs peuvent avoir des « conséquences très graves », notamment en milieu hospitalier, selon Alondra Nelson, qui dirigeait le Bureau des sciences et de la technologie de la Maison Blanche sous l’administration Biden jusqu’à l’année dernière.

« Personne ne souhaite un diagnostic erroné », a déclaré Nelson, aujourd'hui professeur à l'Institute for Advanced Study de Princeton, dans le New Jersey. « Il faut des normes plus strictes. »

Whisper est également utilisé pour créer des sous-titres destinés aux personnes sourdes et malentendantes, une population particulièrement exposée aux erreurs de traduction. En effet, les personnes sourdes et malentendantes n'ont aucun moyen d'identifier les passages inventés « cachés dans le reste du texte », explique Christian Vogler, sourd et directeur du programme d'accessibilité technologique à l'université Gallaudet.

OpenAI est appelé à résoudre le problème

La prévalence de ces « hallucinations » a conduit des experts, des défenseurs des droits et d'anciens employés d'OpenAI à demander au gouvernement fédéral d'envisager une réglementation de l'IA. OpenAI doit au minimum remédier à cette lacune.

« Ce problème peut être résolu si l’entreprise est prête à lui donner la priorité », a déclaré William Saunders, un ingénieur de recherche de San Francisco qui a quitté OpenAI en février en raison de préoccupations concernant l’orientation de l’entreprise.

« Cela pose problème si, après sa publication, les utilisateurs sont tellement convaincus de ses capacités qu'ils l'intègrent à tous les autres systèmes », a déclaré un porte-parole d'OpenAI. L'entreprise travaille constamment à atténuer ces « illusions » et valorise les résultats des chercheurs, ajoutant qu'OpenAI intègre les retours d'expérience dans les mises à jour des modèles.

Alors que la plupart des développeurs supposent que les moteurs de synthèse vocale peuvent faire des fautes de frappe ou d'autres erreurs, les ingénieurs et les chercheurs affirment qu'ils n'ont jamais vu un moteur de synthèse vocale alimenté par l'IA qui « hallucine » autant que Whisper.

Prix Nobel de physique 2024 : les fondateurs de l'IA

Prix Nobel de physique 2024 : les fondateurs de l'IASource : https://tuoitre.vn/cong-cu-ai-chuyen-loi-noi-thanh-van-ban-cua-openai-bi-phat-hien-bia-chuyen-20241031144507089.htm

![[Photo] Le projet d'intersection d'An Phu reliant l'autoroute Ho Chi Minh-Ville-Long Thanh-Dau Giay est en retard](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/21/1ad80e9dd8944150bb72e6c49ecc7e08)

![[Photo] Le Politburo travaille avec le Comité permanent du Comité du Parti de Hanoi et le Comité du Parti de Ho Chi Minh-Ville](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/21/4f3460337a6045e7847d50d38704355d)

Comment (0)