A fines de enero, DeepSeek revolucionó el mundo tecnológico mundial con el lanzamiento de dos modelos LLM que están a la par de los productos estadounidenses pero cuestan una fracción del precio. Entre ellos, el modelo de razonamiento de código abierto DeepSeek-R1 puede resolver algunos de los mismos problemas científicos que o1, el LLM más avanzado de OpenAI.

Aunque el mundo quedó sorprendido, los investigadores nacionales dijeron que el logro era completamente predecible y estaba en línea con la ambición de Beijing de convertirse en una potencia líder en inteligencia artificial (IA).

Yunji Chen, científico informático del Instituto de Ciencias de la Computación de la Academia de Ciencias de China, señala que tarde o temprano aparecerá en China una empresa como DeepSeek.

Esto se debe a la enorme cantidad de capital de inversión que se vierte en las empresas de desarrollo de LLM y al número de personas con doctorados en disciplinas STEM (ciencia, tecnología, ingeniería o matemáticas).

"Si no existiera DeepSeek, habría otros LLM chinos", afirmó Chen.

Este es un hecho comprobado. Días después del “terremoto” de DeepSeek, Alibaba lanzó su LLM más avanzado hasta la fecha, Qwen2.5-Max, que, según afirma, supera a DeepSeek-V3.

Moonshot AI y ByteDance también anunciaron nuevos modelos de inferencia, Kimi 1.5 y 1.5-pro, que pueden superar a o1 en algunas pruebas de referencia.

Prioridades del gobierno

En 2017, el gobierno chino anunció su intención de convertirse en un líder mundial en IA para 2030. China pretende completar grandes avances en IA “para que la tecnología y las aplicaciones alcancen niveles líderes mundiales” para 2025.

Para lograrlo, desarrollar un sistema de talento basado en IA es una máxima prioridad. Para 2022, el Ministerio de Educación de China permitirá que 440 universidades ofrezcan especializaciones en IA, según un informe del Centro de Seguridad y Tecnología Emergente (CSET) de la Universidad de Georgetown.

Ese mismo año, China representaba la mitad de los principales investigadores en IA, mientras que Estados Unidos contribuía sólo con el 18%, según la consultora MacroPolo.

Marina Zhang, investigadora de ciencias políticas en la Universidad de Tecnología de Sydney, dijo que DeepSeek probablemente se benefició de la inversión del gobierno en capacitación en IA y desarrollo de talentos, incluidas numerosas becas, subvenciones de investigación y asociaciones entre la academia y la industria.

Por ejemplo, iniciativas respaldadas por el Estado, como el Laboratorio Nacional de Ingeniería para Tecnologías y Aplicaciones de Aprendizaje Profundo, han capacitado a miles de expertos en IA.

Es difícil encontrar cifras exactas sobre la fuerza laboral de DeepSeek, pero el fundador Liang Wenfeng comparte que la compañía recluta graduados y estudiantes de doctorado de las universidades más grandes del país.

Algunos miembros del equipo de liderazgo tienen menos de 35 años y han crecido con el ascenso de China como superpotencia tecnológica, dijo Zhang. “Están profundamente motivados por la autosuficiencia en la innovación”.

Wenfeng, de 39 años, se graduó en Ciencias de la Computación en la Universidad de Zhejiang. Cofundó el fondo de cobertura High-Flyer hace casi una década y fundó DeepSeek en 2023.

Las políticas nacionales que fomentan un ecosistema modelo para la IA ayudarán a empresas como DeepSeek a atraer financiación y personal, según Jacob Feldgoise, que estudia el talento en IA en China en CSET.

Pero a pesar del aumento de los cursos de IA en las universidades, Feldgoise no tiene claro cuántos estudiantes se gradúan con títulos en IA y si se les están enseñando las habilidades que necesitan las empresas.

En los últimos años, las empresas chinas de IA se han quejado de que los graduados de estos programas no cumplen con sus expectativas, lo que ha llevado a algunas a asociarse con universidades para mejorar la calidad.

"Templado"

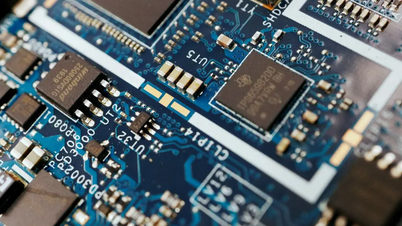

Quizás el elemento más impresionante del éxito de DeepSeek, dicen los científicos, es que desarrollaron DeepSeek-R1 y Janus-Pro-7B en el contexto de los controles de exportación del gobierno de Estados Unidos que han bloqueado el acceso a chips informáticos de inteligencia artificial avanzados desde 2022.

Según Zhang, DeepSeek representa un enfoque claramente chino hacia la innovación, enfatizando la eficiencia frente a una serie de limitaciones.

La startup de Wenfeng dice que utilizó alrededor de 2.000 chips Nvidia H800 para entrenar DeepSeek-V3. Por el contrario, el Llama 3.1 405B, un sofisticado LLM lanzado por Meta en julio de 2024, se basa en más de 16.000 chips Nvidia H100.

En una publicación de WeChat de 2022, High-Flyer dijo que tenía 10,000 de los chips A100 más antiguos de Nvidia. “El problema al que nos enfrentamos nunca ha sido el dinero, sino la prohibición de los chips de alta gama”, declaró Wenfeng a los medios chinos en julio de 2024.

DeepSeek utiliza una variedad de formas para aumentar la eficiencia de sus modelos. Por ejemplo, implementa la arquitectura Mixture of Experts (MoE), un enfoque de aprendizaje automático que entrena modelos más rápido con menos parámetros que las técnicas tradicionales.

Ayuda a DeepSeek a entrenar modelos con menos chips, según el científico informático de la Universidad de Sydney, Chang Xu.

Otra técnica es la atención latente de múltiples cabezas (MLA), que permite al modelo almacenar más datos con menos memoria.

Los logros de DeepSeek podrían ser un “guía” para los países con ambiciones en materia de IA pero que carecen de los recursos financieros y de hardware para formar a una gran cantidad de LLM, dijo Yanbo Wang, investigador de ciencias políticas de la Universidad de Hong Kong.

(Según la Naturaleza, la Fortuna)

Fuente: https://vietnamnet.vn/cach-trung-quoc-tao-ra-deepseek-va-rung-chuyen-the-gioi-2391114.html

![[Foto] Tropas chinas, laosianas y camboyanas participan en el desfile para celebrar el 50 aniversario de la Liberación del Sur y el Día de la Reunificación Nacional.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/4/30/30d2204b414549cfb5dc784544a72dee)

![[Foto] Bloque cultural, deportivo y mediático en el 50º Aniversario del Día de la Liberación del Sur y la Reunificación Nacional](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/4/30/8a22f876e8d24890be2ae3d88c9b201c)

![[Foto] El desfile recorrió las calles, caminando entre los brazos de decenas de miles de personas.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/4/30/180ec64521094c87bdb5a983ff1a30a4)

![[Foto] Actuación del Escuadrón de la Fuerza Aérea en el 50º Aniversario de la Liberación del Sur y el Día de la Reunificación Nacional](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/4/30/cb781ed625fc4774bb82982d31bead1e)

Kommentar (0)