誤情報の拡散に伴う潜在的なリスク

科学技術は、報道機関やメディアがメッセージを伝える方法や、一般大衆のアクセス方法や有効性に影響を与えるだけでなく、情報の質にも大きな影響を与えます。

実際、ジャーナリズムは近年、特に技術革新に迅速に適応してきました。人工知能(AI)は、マスメディアや報道機関の編集室で徐々に普及しつつあります。AIの活用は、ジャーナリストとメディア組織の双方にメリットをもたらしています。ジャーナリストは退屈な定型業務から解放され、時間を節約し、より創造的で高度なスキルを要する仕事に集中できるようになります。

AIには多くの利点がある一方で、懸念も生じます。最も重大なリスクの一つは、AIが生成したコンテンツが誤情報を拡散する可能性があることです。

世界のトップ10の報道機関は、AIツールのトレーニングに使用できる著作権のある素材を管理し、AIアルゴリズムの偏りを排除するために、メディアとAI開発者の間で集団的かつ透明性のある交渉を行うことを求めている。

先週、世界の主要報道機関10社が、AIを対象とした透明性と明確な著作権法の制定を求める書簡に署名しました。報道機関は、AIはニュースの質と誠実さに対する読者の信頼を著しく損なうことにより、「メディアエコシステムの持続可能性を脅かす」可能性があると主張しました。

多くの研究によると、AIは読者の関心を引き、エンゲージメントを高める可能性が最も高いニュースを選別・抽出するために活用され、人間が客観的に作成したニュースであれば生じないようなニュースの偏りを生み出しています。人々はニュースの片側しか知らされず、AIが生成した偏った情報に惑わされてしまう可能性があります。さらに、AIは捏造されたニュースを真実のニュースと並べて提示することで、誤情報やフェイクニュースを拡散させる可能性もあります。

AIはフェイクニュースにも騙される可能性があります。AIアルゴリズムはデータを迅速かつ正確に処理するように設計されているため、真実のニュースとフェイクニュースを見分けることが困難です。さらに、AIは処理するニュースの感情的・道徳的な意味合いを理解することもできません。AIが進化するにつれて、フェイクニュースに対する脆弱性は高まり、真実とフェイクニュースを見分けることがさらに困難になるでしょう。

ジャーナリズム・コミュニケーションアカデミー国際関係学科長のグエン・ゴック・オアン准教授によると、AIが強力になる時こそ、悪意のある人物や敵対勢力がAIを利用して有害で偽のニュースを拡散するリスクに特に注意し、積極的に対応する必要があるということです。メディアセキュリティの観点から見ると、これは誤報、歪曲、フェイクニュースの潜在的なリスクを示しています。AIが情報分野に応用されると、テクノロジーは偽の声や画像、偽の物語や発言を作り出し、特にソーシャルネットワーク上で人々を欺くために本物らしく見えるようにすることが可能になります。

「悪意のある者は、報道機関の役割と評判を利用して情報を偽造し、報道機関が提供・反映した情報であると信じ込ませようとします。フェイクニュースの進化はますます巧妙かつ複雑化するため、警戒心を高めるとともに、フェイクニュースの特定、対応、そして対処方法には、スマートテクノロジーへの投資と体系的な対応に重点を置く必要があります。変化に適応するために、社会管理と報道機関の管理能力を向上させる必要があります」と、グエン・ゴック・オアン准教授は述べました。

ニュース業界は創造的なコンテンツを保護する方法を見つけなければなりません。

2022年11月のChatGPTのリリース以来、生成AI(Generative AI)をベースにした新しいアプリケーションがほぼ毎日のように導入されています。その結果、インターネットはAI生成コンテンツで溢れかえっています。中には衝撃的なコンテンツもある一方で、単調で繰り返しの多いコンテンツも数多く存在します。これは誤情報の拡散を容易にし、読者との信頼関係を構築・回復するというメディア業界の負担を増大させています。

ベトナムプラス紙副編集長のグエン・ホアン・ニャット記者は、多くの専門家が指摘した過去の教訓を振り返り、報道機関が犯した最初の大きな過ちの一つは、ソーシャルネットワークの重要性と侵略への対応が遅すぎたことだと指摘した。 「私たちは長年、制作するすべてのコンテンツをソーシャルネットワーク上に置き、そのために最も核心となる部分を変えてきました。しかし、それは時に私たちの強みにも読者のニーズにも合わないものでした。つまり、私たちはソーシャルネットワークに力を与えすぎ、結果的にソーシャルネットワークに飲み込まれてしまったのです」と、グエン・ホアン・ニャット記者は述べた。

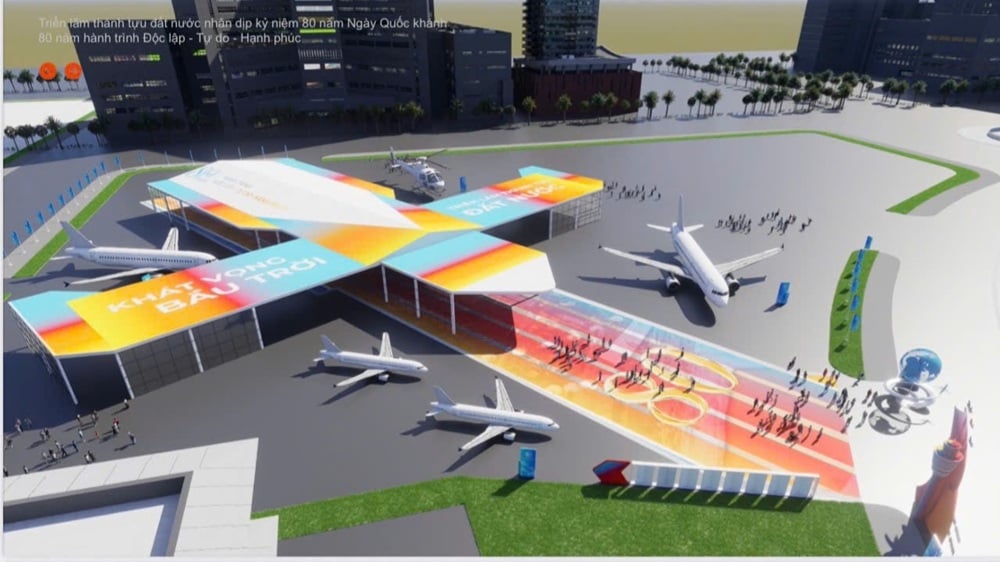

ベトナム女子チームがワールドカップに出場していた当時、ソーシャルメディアには歪曲・捏造された情報が溢れていた。(写真:VTC)

AIの現在の脅威について、ジャーナリストのグエン・ホアン・ニャット氏は、AIは一般的にニュース編集室の業務を迅速化し、コストを削減するのに役立つが、編集者や記者の寛容さを高め、偽情報の拡散を加速させる一因にもなると述べた。 「例えば、先日の女子ワールドカップでは、ベトナム女子代表チームに関する偽コンテンツがAIツールで作成されたミームを通じて恐ろしく『バイラル』に拡散し、一部の視聴者の心理を極端にまで追い詰めました」と、ジャーナリストのグエン・ホアン・ニャット氏は例を挙げた。

海外では、ニュースガードが衝撃的な統計を発見しました。正規のニュースサイトのように見える347のニュースサイトが、AIが生成したコンテンツで溢れ、偽情報を拡散しているのです。マサチューセッツ工科大学(MIT)の最近の研究では、人間が生成したフェイクニュースよりも、AIが生成した偽情報を信じる人が多いことが明らかになりました。

ジャーナリストのグエン・ホアン・ニャット氏によると、この現実により、報道業界は創造的なコンテンツと知的財産を保護する方法を見つけなければならない立場に立たされているが、同時にAIがもたらす利便性を無視することもできないという。

ニュースの真実性における課題を評価したグエン・ゴック・オアン准教授は、Chat GPTには多くの優れた機能があるものの、結局のところ、ジャーナリストはそれを習得し、職業倫理に従って記事を執筆し、報道活動に役立てるツールに過ぎないと述べた。記者やジャーナリストが不正確な情報の拡散を「助長」したくないのであれば、情報源の検証は極めて重要である。

人工知能に関する多くのセミナーや議論を通じて、編集部におけるコンテンツ管理がデジタル技術の発展に追いつかない場合、ジャーナリズム作品において偽データや偽ニュースが使用されるリスクが非常に高いという結論に達しています。ベトナムにおけるデジタルジャーナリズムの法的枠組みが未だ現実に追いついていない状況において、法的トラブル、メディアの安全保障への脅威、著作権侵害事件、ジャーナリズム倫理に関する論争、自動化ジャーナリズムの適用におけるジャーナリズムの社会的責任などが、今日の大きな課題となっています。

ファンホアザン

[広告2]

ソース

コメント (0)