บริษัทเทคโนโลยียักษ์ใหญ่ OpenAI ยกย่องเครื่องมือแปลงคำพูดเป็นข้อความ Whisper ว่าเป็น AI ที่มี “ความแม่นยำและความทนทานเทียบเท่ามนุษย์” แต่ Whisper มีข้อบกพร่องสำคัญประการหนึ่ง นั่นคือ มันสร้างข้อความและประโยคปลอมๆ ขึ้นมาได้

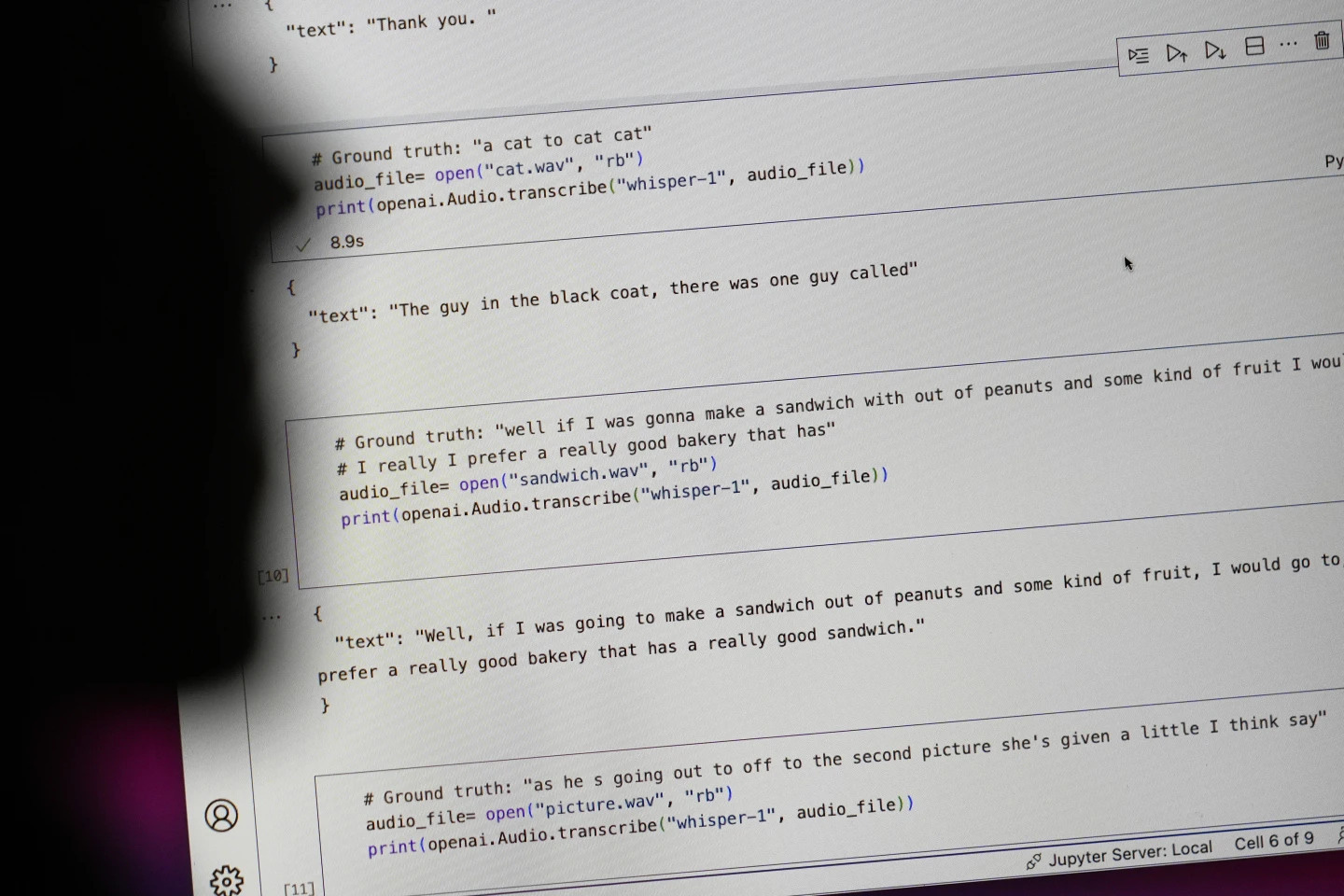

ข้อความบางส่วนที่สร้างโดย AI เรียกว่า "ภาพหลอน" ซึ่งอาจรวมถึงความคิดเห็นเกี่ยวกับเชื้อชาติ ภาษาที่รุนแรง และแม้แต่การรักษา ทางการแพทย์ ในจินตนาการ - ภาพ: AP

ข้อความบางส่วนที่สร้างโดย AI นั้นไม่จริง เรียกว่า "ภาพหลอน" ตามที่ AP รายงาน และมีทั้งข้อคิดเห็นเกี่ยวกับเชื้อชาติ ภาษาที่รุนแรง และแม้แต่การรักษาทางการแพทย์ในจินตนาการ

อัตราการเกิด "ภาพลวงตา" สูงในข้อความที่สร้างโดย AI

ผู้เชี่ยวชาญมีความกังวลเป็นพิเศษเนื่องจาก Whisper ถูกใช้กันอย่างแพร่หลายในหลายอุตสาหกรรมทั่ว โลก ในการแปลและถอดเสียงบทสัมภาษณ์ สร้างข้อความในเทคโนโลยีสำหรับผู้บริโภคยอดนิยม และสร้างคำบรรยายสำหรับวิดีโอ

ที่น่ากังวลยิ่งกว่านั้น คือ ศูนย์การแพทย์หลายแห่งกำลังใช้ Whisper ในการถ่ายโอนการให้คำปรึกษาระหว่างแพทย์และคนไข้ แม้ว่า OpenAI จะเตือนว่าไม่ควรใช้เครื่องมือนี้ในพื้นที่ที่มี "ความเสี่ยงสูง" ก็ตาม

ขอบเขตทั้งหมดของปัญหานี้เป็นเรื่องยากที่จะระบุได้ แต่บรรดานักวิจัยและวิศวกรกล่าวว่าพวกเขาพบกับ "ภาพหลอน" ของ Whisper เป็นประจำในการทำงานของพวกเขา

นักวิจัยจากมหาวิทยาลัยมิชิแกนกล่าวว่าเขาพบ "ภาพหลอน" ในไฟล์เสียงถอดความแปดในสิบไฟล์ที่เขาตรวจสอบ วิศวกรคอมพิวเตอร์พบ "ภาพหลอน" ประมาณครึ่งหนึ่งของไฟล์เสียงถอดความกว่า 100 ชั่วโมงที่เขาวิเคราะห์ นักพัฒนาอีกรายกล่าวว่าเขาพบ "ภาพหลอน" ในไฟล์เสียงเกือบทั้งหมด 26,000 ไฟล์ที่เขาสร้างขึ้นโดยใช้ Whisper

ปัญหายังคงอยู่แม้จะมีตัวอย่างเสียงสั้นๆ ที่บันทึกไว้อย่างชัดเจนก็ตาม การศึกษาเมื่อเร็วๆ นี้โดย นักวิทยาศาสตร์ คอมพิวเตอร์พบ "ภาพลวงตา" 187 ภาพในคลิปเสียงที่ชัดเจนกว่า 13,000 คลิปที่พวกเขาตรวจสอบ นักวิจัยกล่าวว่าแนวโน้มนี้จะนำไปสู่การถอดเสียงผิดพลาดหลายหมื่นครั้งในไฟล์บันทึกเสียงหลายล้านไฟล์

ข้อผิดพลาดดังกล่าวอาจก่อให้เกิด "ผลกระทบร้ายแรงมาก" โดยเฉพาะอย่างยิ่งในโรงพยาบาล ตามที่ Alondra Nelson ซึ่งดำรงตำแหน่งหัวหน้าสำนักงานวิทยาศาสตร์และเทคโนโลยีทำเนียบขาวในรัฐบาลของ Biden จนถึงปีที่แล้ว กล่าว

“ไม่มีใครอยากให้การวินิจฉัยผิดพลาด” เนลสัน ซึ่งปัจจุบันเป็นศาสตราจารย์ประจำสถาบันเพื่อการศึกษาขั้นสูงในพรินซ์ตัน รัฐนิวเจอร์ซีย์ กล่าว “จำเป็นต้องมีมาตรฐานที่สูงขึ้น”

นอกจากนี้ Whisper ยังใช้เพื่อสร้างคำบรรยายสำหรับผู้พิการทางการได้ยินและผู้ที่มีปัญหาทางการได้ยิน ซึ่งเป็นกลุ่มประชากรที่มีความเสี่ยงสูงต่อการแปลผิด เนื่องจากผู้พิการทางการได้ยินและผู้ที่มีปัญหาทางการได้ยินไม่สามารถระบุข้อความที่แต่งขึ้น “ซึ่งซ่อนอยู่ในข้อความอื่นๆ ทั้งหมด” คริสเตียน วอกเลอร์ ผู้พิการทางการได้ยินและผู้อำนวยการโครงการการเข้าถึงเทคโนโลยีแห่งมหาวิทยาลัยกัลลอเด็ต กล่าว

OpenAI ถูกเรียกใช้เพื่อแก้ไขปัญหา

การแพร่หลายของ "ภาพหลอน" ดังกล่าวทำให้ผู้เชี่ยวชาญ ผู้สนับสนุน และอดีตพนักงาน OpenAI เรียกร้องให้รัฐบาลกลางพิจารณากฎระเบียบด้าน AI อย่างน้อยที่สุด OpenAI จำเป็นต้องแก้ไขข้อบกพร่องนี้

“ปัญหาจะแก้ไขได้หากบริษัทยินดีที่จะให้ความสำคัญกับเรื่องนี้” วิลเลียม ซอนเดอร์ส วิศวกรวิจัยในซานฟรานซิสโก ซึ่งลาออกจาก OpenAI เมื่อเดือนกุมภาพันธ์เนื่องจากกังวลเกี่ยวกับทิศทางของบริษัท กล่าว

“มันจะเป็นปัญหาถ้าคุณปล่อยมันออกมา แล้วผู้คนมั่นใจในสิ่งที่มันทำได้มากจนนำมันไปรวมเข้ากับระบบอื่นๆ ทั้งหมด” โฆษกของ OpenAI กล่าว บริษัทกำลังพยายามอย่างต่อเนื่องที่จะหาวิธีลด “ภาพลวงตา” เหล่านี้ และให้ความสำคัญกับผลการวิจัยของนักวิจัย โดยเสริมว่า OpenAI ได้นำฟีดแบ็กมาปรับใช้กับการปรับปรุงโมเดล

ในขณะที่นักพัฒนาส่วนใหญ่มักจะคิดว่าเครื่องมือแปลงข้อความเป็นเสียงสามารถพิมพ์ผิดหรือทำผิดพลาดอื่นๆ ได้ วิศวกรและนักวิจัยกล่าวว่าพวกเขาไม่เคยเห็นเครื่องมือแปลงข้อความเป็นเสียงที่ขับเคลื่อนด้วย AI ที่ "ทำให้เกิดภาพหลอน" ได้มากเท่ากับ Whisper เลย

รางวัลโนเบลสาขาฟิสิกส์ 2024: ผู้ก่อตั้ง AI

รางวัลโนเบลสาขาฟิสิกส์ 2024: ผู้ก่อตั้ง AIที่มา: https://tuoitre.vn/cong-cu-ai-chuyen-loi-noi-thanh-van-ban-cua-openai-bi-phat-hien-bia-chuyen-20241031144507089.htm

![[ภาพ] ประธานาธิบดีเลืองเกวงเข้าร่วมรายการโทรทัศน์การเมืองและศิลปะพิเศษ "โอกาสทอง"](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/22/44ca13c28fa7476796f9aa3618ff74c4)

การแสดงความคิดเห็น (0)