По данным BGR , в новом исследовательском отчете была опубликована тревожная технология под названием «Fun-Tuning», при которой сам ИИ (искусственный интеллект) используется для автоматического создания чрезвычайно эффективных атак с мгновенными инъекциями, нацеленных на другие продвинутые модели ИИ, включая Gemini от Google.

Этот метод делает «взлом» ИИ быстрее, дешевле и проще, чем когда-либо, что знаменует собой новую эскалацию битвы за кибербезопасность с участием ИИ.

Опасность, когда плохие парни используют ИИ, чтобы взломать ИИ

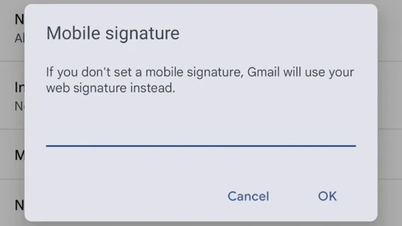

Внедрение подсказок — это метод, при котором злоумышленник тайно вставляет вредоносные инструкции во входные данные модели ИИ (например, через комментарии в исходном коде, скрытый текст в Интернете). Цель состоит в том, чтобы «обмануть» ИИ, заставив его обойти заранее запрограммированные правила безопасности, что приведет к серьезным последствиям, таким как утечка конфиденциальных данных, предоставление ложной информации или выполнение других опасных действий.

Хакеры используют ИИ для атак на ИИ

ФОТО: СКРИНШОТ LINKEDIN

Раньше для успешного выполнения таких атак, особенно на «закрытых» моделях, таких как Gemini или GPT-4, часто требовалось много сложного и трудоемкого ручного тестирования.

Но Fun-Tuning полностью изменил правила игры. Метод, разработанный группой исследователей из нескольких университетов, умело использует тот же тонко настроенный интерфейс прикладного программирования (API), который Google предоставляет бесплатно пользователям Gemini.

Анализируя тонкие реакции модели Gemini во время настройки (например, как она реагирует на ошибки в данных), Fun-Tuning может автоматически определять наиболее эффективные «префиксы» и «суффиксы» для сокрытия вредоносного утверждения. Это значительно увеличивает вероятность того, что ИИ будет следовать злонамеренным намерениям злоумышленника.

Результаты испытаний показывают, что на некоторых версиях Gemini показатель успешности Fun-Tuning достигает 82%, что превышает показатель традиционных методов атаки, составляющий менее 30%.

Опасность Fun-Tuning усугубляется тем, что стоимость его внедрения очень низкая. Поскольку API-интерфейс Google для настройки находится в свободном доступе, вычислительные затраты на создание эффективной атаки могут составить всего 10 долларов. Более того, исследователи обнаружили, что атака, разработанная для одной версии Gemini, может быть легко успешно применена к другим версиям, что создает риск широкомасштабных атак.

Компания Google подтвердила, что знает об угрозе, которую представляет технология Fun-Tuning, но пока не прокомментировала, изменит ли она работу API настройки. Команда также указывает на сложность защиты, заключающуюся в том, что если информация, которую использует Fun-Tuning, будет удалена из процесса настройки, API станет менее полезным для настоящих разработчиков. Напротив, если оставить все как есть, оно по-прежнему будет служить плацдармом для злоумышленников.

Появление Fun-Tuning — это явное предупреждение о том, что противостояние в киберпространстве вступило в новую, более сложную фазу. ИИ теперь является не только целью, но и инструментом и оружием в руках злоумышленников.

Источник: https://thanhnien.vn/hacker-dung-ai-de-tan-cong-gemini-cua-google-18525033010473121.htm

![[Фото] Панорама парада в честь 50-летия Освобождения Юга и Национального Воссоединения](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/4/30/affbd72e439d4362962babbf222ffb8b)

![[Фото] Массовый парад в честь 50-летия национального воссоединения](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/4/30/825e459ee2f54d85b3a134cdcda46e0d)

Комментарий (0)