ការប្រើប្រាស់បញ្ញាសិប្បនិម្មិត (AI) ដើម្បីធ្វើការបានក្លាយជានិន្នាការជៀសមិនរួច ដែលជួយបង្កើនប្រសិទ្ធភាព និងសន្សំសំចៃពេលវេលា។

ទោះជាយ៉ាងណាក៏ដោយ នៅពីក្រោយភាពងាយស្រួលនោះគឺជាហានិភ័យដែលអាចកើតមានចំពោះសុវត្ថិភាពទិន្នន័យ ជាពិសេសបាតុភូត "Shadow AI" នៅពេលដែលបុគ្គលិកប្រើប្រាស់ឧបករណ៍ AI ដោយមិនប្រុងប្រយ័ត្ន ដោយគ្មានការគ្រប់គ្រង ការដាក់ទិន្នន័យសម្ងាត់របស់ក្រុមហ៊ុនដោយចៃដន្យនៅលើវេទិកាសាធារណៈ។

ភាពអាស្រ័យនិងកង្វល់ដំបូង

Thanh Huyen (អាយុ 21 ឆ្នាំ) ជាបុគ្គលិកផ្នែក Content Marketing នៅក្រុមហ៊ុនគ្រឿងសំអាង និងអាហារដែលមានមុខងារបានចែករំលែកថា នាងពឹងផ្អែកលើ AI 90% ក្នុងការងាររបស់នាង ចាប់ពីការធ្វើផែនការ ការកសាងខ្លឹមសារ រហូតដល់ការរចនារូបភាព និង វីដេអូ ។

ទោះជាយ៉ាងណាក៏ដោយ នៅពេលដែលនាងបានជួបដោយចៃដន្យនូវអត្ថបទមួយដែលស្រដៀងនឹងគំនិតដែលនាងបានសួរទៅកាន់ ChatGPT នោះ Huyen ចាប់ផ្តើមព្រួយបារម្ភអំពីសមត្ថភាពរបស់ AI ក្នុងការចងចាំ និងចែករំលែកព័ត៌មានបញ្ចូល។

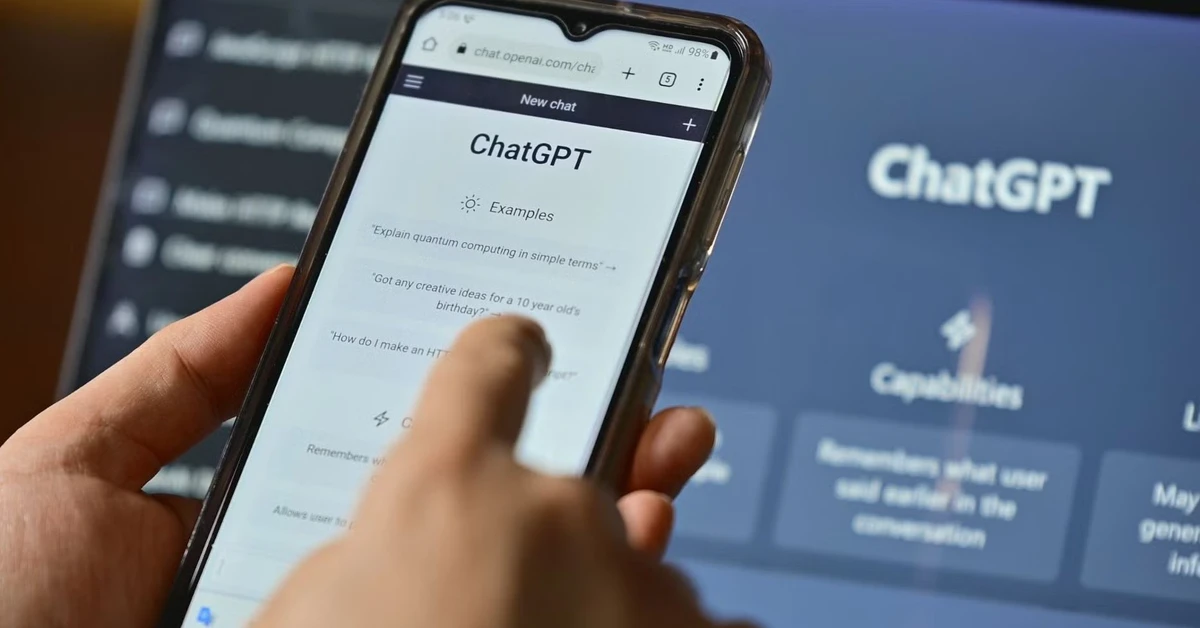

ការអនុវត្ត AI ដើម្បីធ្វើការស្ទើរតែក្លាយជាលំនាំដើមសម្រាប់ឧស្សាហកម្មជាច្រើននៅពេលបច្ចុប្បន្ន (រូបថត៖ ប៉ោង៉ុក) ។

ខណៈពេលដែលរឿងរបស់ Huyen អាចជារឿងចៃដន្យ ប៉ុន្តែការពិតដែលមិនអាចប្រកែកបាននោះគឺថាការផ្តល់ព័ត៌មានដល់ AI មានន័យថាអនុញ្ញាតឱ្យឧបករណ៍ទាំងនេះប្រមូល និងរក្សាទុកទិន្នន័យដើម្បីបណ្តុះបណ្តាលគំរូ។

បញ្ហាកាន់តែធ្ងន់ធ្ងរ ប្រសិនបើវេទិកា AI ត្រូវបានលួចចូល ឬមានសុវត្ថិភាពមិនល្អ ដែលនាំទៅដល់ការលេចធ្លាយព័ត៌មាន និងផលវិបាកអវិជ្ជមាន។

"ស្រមោល AI" - គ្រោះថ្នាក់ដែលអាចកើតមាន

HM (អាយុ 20 ឆ្នាំ) ដែលជាអ្នកឯកទេសផ្នែកសេវាកម្មអតិថិជន តែងតែផ្តល់បញ្ជីព័ត៌មានអតិថិជន (ឈ្មោះពេញ ថ្ងៃខែឆ្នាំកំណើត លេខទូរស័ព្ទ ប្រវត្តិទិញ) ទៅកាន់ AI សម្រាប់ការវិភាគ សន្សំពេលវេលា និងបង្កើនប្រសិទ្ធភាពការងារ។

M. ជឿជាក់ថា នេះមិនមែនជាហានិភ័យដែលអាចកើតមាននោះទេ ដោយសារតែក្រុមហ៊ុននេះតូច ហើយទិន្នន័យនឹងមិនត្រូវបានបង្ហាញឱ្យដឹងនោះទេ។ ទោះយ៉ាងណាក៏ដោយ ករណីរបស់ M. គឺជារឿងធម្មតានៃ "Shadow AI" - ការប្រើប្រាស់ AI ដោយបុគ្គលិកដោយគ្មានការយល់ព្រម ឬការត្រួតពិនិត្យពីផ្នែកបច្ចេកវិទ្យាព័ត៌មាន ឬផ្នែកសន្តិសុខតាមអ៊ីនធឺណិត។

បាតុភូតនៃ “Shadow AI” សំដៅលើការប្រើប្រាស់ AI ដោយបុគ្គលិកនៅក្នុងអាជីវកម្មដោយគ្មានការគ្រប់គ្រង ឬការគ្រប់គ្រងណាមួយឡើយ (រូបភាព៖ CV)។

របាយការណ៍របស់ Cisco បានរកឃើញថា 62% នៃអង្គការនៅក្នុងប្រទេសវៀតណាមខ្វះទំនុកចិត្តក្នុងការរកឃើញការប្រើប្រាស់ AI ដោយមិនមានការគ្រប់គ្រងដោយបុគ្គលិក។ ការស្ទង់មតិរបស់ចក្រភពអង់គ្លេសក៏បានរកឃើញថា 75% នៃអ្នកគ្រប់គ្រងសន្តិសុខតាមអ៊ីនធឺណិតមានការព្រួយបារម្ភអំពីការគំរាមកំហែងខាងក្នុងដូចជា Shadow AI ជាដើម។

នេះបង្ហាញថា Shadow AI កំពុងក្លាយជាការគំរាមកំហែងទូទៅ ជាពិសេសនៅពេលដែលអាជីវកម្មជាច្រើនមិនមានគោលការណ៍ច្បាស់លាស់លើការប្រើប្រាស់ AI ហើយបុគ្គលិកខ្វះការយល់ដឹងអំពីសុវត្ថិភាពទិន្នន័យ។

ទទួលយកការដោះដូរដើម្បីជៀសវាងការចាកចេញ

ទោះបីជាដឹងអំពីហានិភ័យក៏ដោយ Thanh Huyen នៅតែទទួលយក "ភ្នាល់" លើ AI ។ នាងជឿថាអត្ថប្រយោជន៍ភ្លាមៗដែល AI នាំមកគឺអស្ចារ្យពេក ដែលជួយនាងបង្កើតអត្ថបទ និងគំនិតរាប់សិបជារៀងរាល់ថ្ងៃ។

ភាពងាយស្រួល ល្បឿន និងសមត្ថភាពក្នុងការបង្កើនការអនុវត្តបានធ្វើឱ្យ Huyen មានឆន្ទៈក្នុងការផ្តល់នូវព័ត៌មានរសើប និងសម្ងាត់ដល់ AI សូម្បីតែព័ត៌មានផ្ទាល់ខ្លួនរបស់ថ្នាក់លើរបស់នាងក៏ដោយ។

ទោះបីជាមានហានិភ័យសក្តានុពលនៃការប្រើប្រាស់ AI ដោយគ្មានការគ្រប់គ្រងក៏ដោយ ក៏បុគ្គលិកជាច្រើននៅតែទទួលយកការដោះដូរសម្រាប់អត្ថប្រយោជន៍ភ្លាមៗ (រូបភាព៖ CV)។

ស្រដៀងគ្នានេះដែរ លោក Trung Hieu (អាយុ 20 ឆ្នាំ) ដែលជាបុគ្គលិកផ្នែកទីផ្សារមាតិកា ក៏ផ្តល់ឯកសារផ្ទៃក្នុង និងព័ត៌មានអាជីវកម្មជាប្រចាំដល់ AI chatbot ផងដែរ។

Hieu បានកត់សម្គាល់ពីការកើនឡើងគួរឱ្យកត់សម្គាល់នៃផលិតភាព ដែលបង្កើតនូវគុណសម្បត្តិប្រកួតប្រជែង ហើយជឿជាក់ថាវាមិនប៉ះពាល់ដល់ប្រតិបត្តិការរបស់ក្រុមហ៊ុនខ្លាំងពេកនោះទេ។

ករណីទាំងនេះបង្ហាញថា Shadow AI កំពុងរីករាលដាលដោយសារតែកង្វះគោលនយោបាយច្បាស់លាស់ពីក្រុមហ៊ុន និងការយល់ដឹងមិនគ្រប់គ្រាន់ក្នុងចំណោមបុគ្គលិកអំពីហានិភ័យសុវត្ថិភាព គុណភាព និងភាពអាស្រ័យ។

ហានិភ័យជាបន្តបន្ទាប់នៅពេលជឿជាក់លើ AI ច្រើនពេក

លោក Nguyen Viet Hung នាយកប្រតិបត្តិនៃក្រុមហ៊ុនអភិវឌ្ឍន៍កម្មវិធី AI ពន្យល់ពីប្រជាប្រិយភាពរបស់ Shadow AI ដោយសារកត្តាបីយ៉ាង៖ AI ជួយឱ្យដំណើរការលឿន និងមានប្រសិទ្ធភាពជាងមុន។ ទំលាប់នៃការពឹងផ្អែកលើទម្រង់ AI យ៉ាងឆាប់រហ័ស; ហើយអាជីវកម្មខ្វះការព្រមាន និងការបណ្តុះបណ្តាលអំពីហានិភ័យ។

លោក Nguyen Viet Hung នាយកប្រតិបត្តិនៃក្រុមហ៊ុនអភិវឌ្ឍន៍កម្មវិធី AI (រូបថត៖ Cong Khanh)។

អ្នកជំនាញព្រមានថា Shadow AI អាចនាំឱ្យមានការលេចធ្លាយទិន្នន័យ (អតិថិជន ខាងក្នុង) នៅពេលដាក់លើឧបករណ៍ AI ឥតគិតថ្លៃ។

លើសពីនេះ គុណភាពនៃមាតិកាដែលបង្កើតដោយ AI មិនត្រូវបានផ្ទៀងផ្ទាត់ ដែលអាចនាំឱ្យមានភាពលំអៀង និងប៉ះពាល់ដល់ការសម្រេចចិត្តអាជីវកម្មយ៉ាងងាយស្រួល។

ធ្ងន់ធ្ងរជាងនេះទៅទៀត ការប្រើប្រាស់ AI ដែលមិនអាចគ្រប់គ្រងបានអាចបង្កើតភាពងាយរងគ្រោះផ្នែកសុវត្ថិភាព ដែលធ្វើឱ្យវាពិបាកសម្រាប់ប្រព័ន្ធ IT ក្នុងការត្រួតពិនិត្យ និងឆ្លើយតបភ្លាមៗ និងធ្វើឱ្យពិបាកក្នុងការកំណត់ការទទួលខុសត្រូវនៅពេលឧប្បត្តិហេតុកើតឡើង។

តំបន់ងងឹតពិបាកគ្រប់គ្រង។

ការត្រួតពិនិត្យ និងគ្រប់គ្រងបុគ្គលិកដោយប្រើ AI គឺជាដំណើរការដ៏យូរ និងសម្របសម្រួល។ អ្នកជំនាញនិយាយថា និយោជិតដែលមានសិទ្ធិចូលប្រើទិន្នន័យខាងក្នុងបង្កជាឧបសគ្គធំក្នុងការរារាំងពួកគេមិនឱ្យឆ្លងកាត់ទិន្នន័យឯកជនតាមរយៈឧបករណ៍ AI ផ្ទាល់ខ្លួន។

លើសពីនេះ ឧបករណ៍ AI ឥឡូវនេះអាចចូលប្រើបានយ៉ាងងាយស្រួល ដែលធ្វើឱ្យពួកវាពិបាកសម្រាប់ IT ក្នុងការរកឃើញ ឬគ្រប់គ្រង។

ភាពងាយស្រួលនៃការប្រើប្រាស់ឧបករណ៍ AI គឺជាឧបសគ្គមួយដែលធ្វើឱ្យមានការលំបាកក្នុងការគ្រប់គ្រងព័ត៌មានដែលបុគ្គលិកដាក់នៅលើវេទិកា AI (រូបភាព៖ CV) ។

ដើម្បីទប់ទល់ អ្នកជំនាញ Nguyen Viet Hung បានស្នើថា អាជីវកម្មត្រូវបង្កើនការបណ្តុះបណ្តាលបុគ្គលិកលើការយល់ដឹងអំពីហានិភ័យនៅពេលប្រើប្រាស់ AI និងទទួលបានការយល់ដឹងកាន់តែស៊ីជម្រៅអំពី "Shadow AI"។

ទន្ទឹមនឹងនោះ ត្រូវចេញបទបញ្ជាច្បាប់ និងគោលនយោបាយផ្ទៃក្នុងឱ្យបានឆាប់។ ដំណោះស្រាយសំខាន់មួយទៀតគឺការពង្រឹងសមត្ថភាពសន្តិសុខនៅសហគ្រាស រួមទាំងការត្រួតពិនិត្យអាកប្បកិរិយា ការគ្រប់គ្រងការចូលប្រើទិន្នន័យ និងការអនុញ្ញាតយ៉ាងប្រុងប្រយ័ត្នសម្រាប់បុគ្គលិកម្នាក់ៗ។

បច្ចុប្បន្ននេះ ក្រុមហ៊ុនជាច្រើននៅតែមិនទាន់មានដំណើរការច្បាស់លាស់សម្រាប់ការប្រើប្រាស់ AI ដោយគ្រាន់តែលើកទឹកចិត្តឱ្យប្រើប្រាស់ដើម្បីបង្កើនផលិតភាពប៉ុណ្ណោះ។ ដើម្បីដោះស្រាយជាមួយ Shadow AI សហគ្រាសធំៗជាច្រើនបានចាប់ផ្តើមដាក់ពង្រាយវេទិកា AI ខាងក្នុង ឬតម្រូវឱ្យបុគ្គលិកប្រើប្រាស់ឧបករណ៍ដែលត្រូវបានអនុម័តជាមួយនឹងគោលការណ៍សុវត្ថិភាពព័ត៌មានច្បាស់លាស់។

ប្រភព៖ https://dantri.com.vn/cong-nghe/sep-buong-long-nhan-vien-than-nhien-cap-du-lieu-mat-cho-ai-20250806090132034.htm

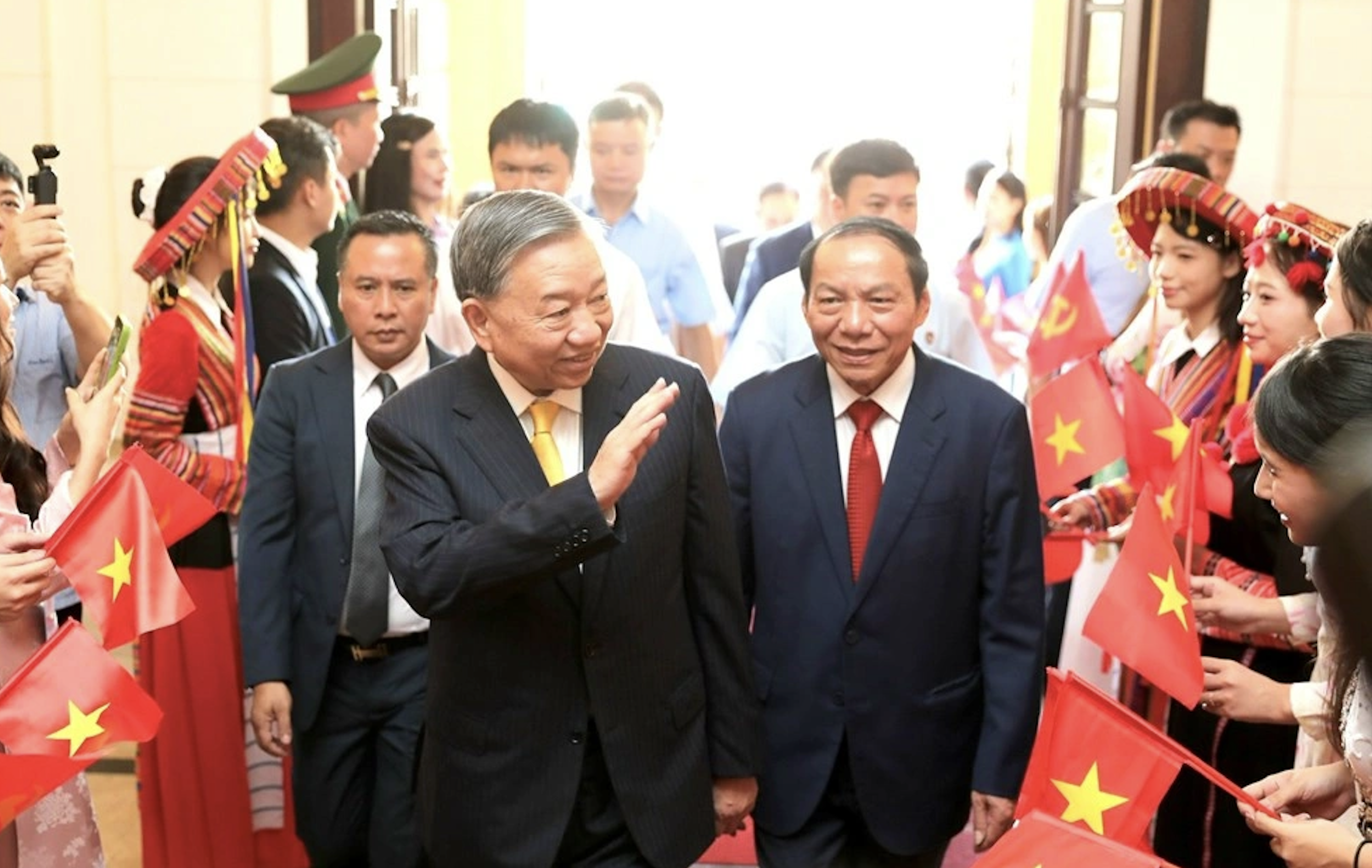

![[រូបថត] នាយករដ្ឋមន្ត្រី Pham Minh Chinh ធ្វើជាអធិបតីកិច្ចប្រជុំគណៈកម្មាធិការអចិន្ត្រៃយ៍បក្សរដ្ឋាភិបាល](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/23/8e94aa3d26424d1ab1528c3e4bbacc45)

![[រូបថត] អគ្គលេខាធិកា To Lam ចូលរួមក្នុងខួបលើកទី 80 នៃទិវាប្រពៃណីនៃវិស័យវប្បធម៌](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/23/7a88e6b58502490aa153adf8f0eec2b2)

Kommentar (0)