Deepfake est une technologie d'intelligence artificielle permettant de créer de fausses vidéos , images et sons avec un haut degré d'authenticité. Il est donc essentiel de comprendre les informations nécessaires pour reconnaître les vidéos Deepfake afin d'éviter les arnaques et d'identifier les fausses informations.

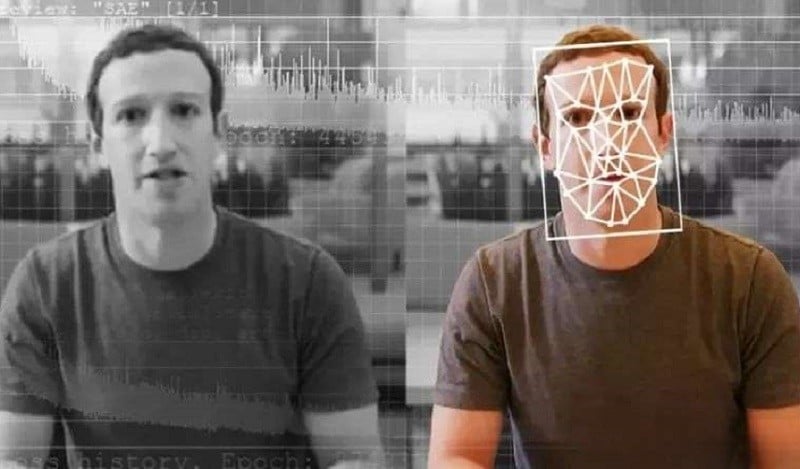

Vérifiez les mouvements du visage

L'un des signes les plus évidents d'une fausse vidéo est le mouvement anormal des yeux et l'absence de clignement des yeux. Les deepfakes présentent encore de nombreuses limites : la technologie ne peut pas simuler entièrement le clignement des yeux humain ni reproduire fidèlement les mouvements oculaires.

|

| Vérifiez les mouvements du visage pour détecter les fausses vidéos Deepfake. |

De plus, vous pouvez également reconnaître les fausses vidéos Deepfake grâce à des émotions faciales qui ne correspondent pas au contenu, à la couleur de la peau, aux cheveux et aux dents qui ne sont pas les mêmes que dans la réalité, ou à des lumières étranges apparaissant en raison de l'utilisation de l'intelligence artificielle pour recréer.

Qualité sonore

Vous pouvez reconnaître les fausses vidéos créées par Deepfake grâce au son, car cette technologie se concentre davantage sur la reproduction d'images et de vidéos. Soyez attentif aux mouvements de la bouche lorsque la personne parle pour vérifier si le son correspond à l'image.

|

| Vérifiez la qualité du son. |

Posture de l'appelant

Actuellement, la technologie Deepfake ne peut reproduire parfaitement les postures humaines. Il arrive que l'interlocuteur apparaisse dans la vidéo dans des postures « étranges », peu humaines. Par exemple, les postures inconfortables et l'orientation de la tête et du corps dans la vidéo sont incohérentes.

Avec le développement croissant de l'intelligence artificielle, il est facile de créer une vidéo deepfake pour usurper l'identité d'autrui et escroquer, car cette pratique exploite la peur et l'ignorance des utilisateurs. Il est donc essentiel de se doter de connaissances de base pour les éviter et de se méfier des appels, messages et e-mails suspects. Si vous détectez des signes de fraude, contactez directement les autorités pour vérifier les informations et signalez-les au commissariat le plus proche.

Source

![[Photo] Les dirigeants du parti et de l'État rencontrent des représentants de tous les horizons](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/24/66adc175d6ec402d90093f0a6764225b)

![[Photo] Phu Quoc : Diffuser la prévention et le contrôle de la pêche INN auprès de la population](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/24/f32e51cca8bf4ebc9899accf59353d90)

Comment (0)