Aktuelle KI-Anwendungen können falsche Gesichter erstellen

Laut AP, die sich gestern auf einen Bericht dieser Organisation berief, haben viele Menschen KI verwendet, um die Gesichter echter Menschen in Nacktbilder oder -videos einzufügen, und sogar selbst falsche Gesichter entworfen, um pornografische „Werke“ zu erstellen.

Wenn nichts unternommen wird, könnten Milliarden gefälschter Bilder es Ermittlern erschweren, wirklich gefährdete Kinder zu retten. Böswillige Akteure könnten die Bilder auch nutzen, um sie an Dritte zu verkaufen oder Opfer zu erpressen.

Laut Euronews sind die meisten von KI generierten Bilder von sexuellem Kindesmissbrauch nach den geltenden Gesetzen der USA und Großbritanniens illegal. Es ist jedoch unklar, ob die Strafverfolgungsbehörden über die Mittel verfügen, dies zu verhindern.

[Anzeige_2]

Quellenlink

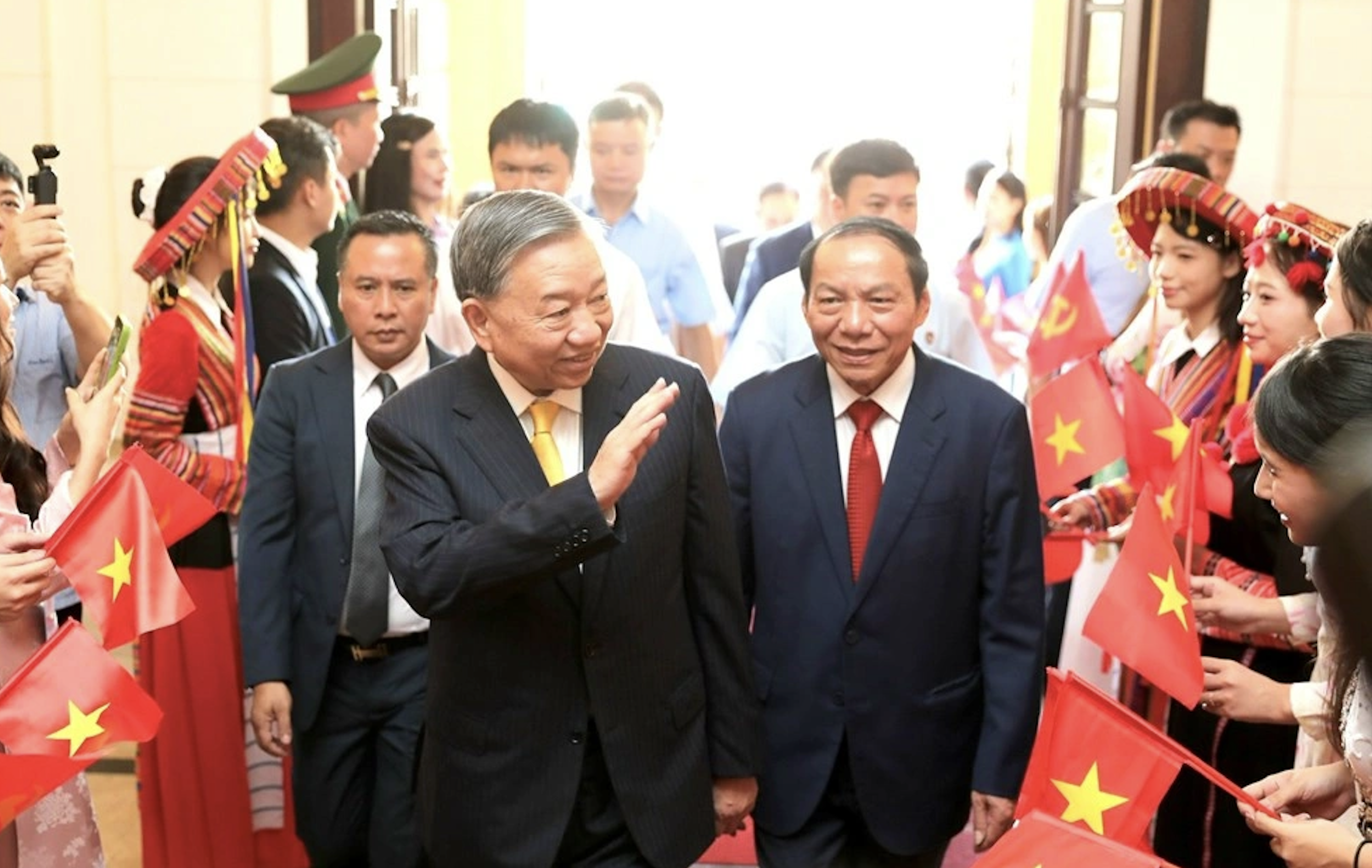

![[Foto] Generalsekretär To Lam nimmt am 80. Jahrestag des traditionellen Tages des Kultursektors teil](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/23/7a88e6b58502490aa153adf8f0eec2b2)

![[Foto] Premierminister Pham Minh Chinh leitet die Sitzung des Ständigen Ausschusses des Regierungsparteikomitees](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/8/23/8e94aa3d26424d1ab1528c3e4bbacc45)

Kommentar (0)